Try in Colab

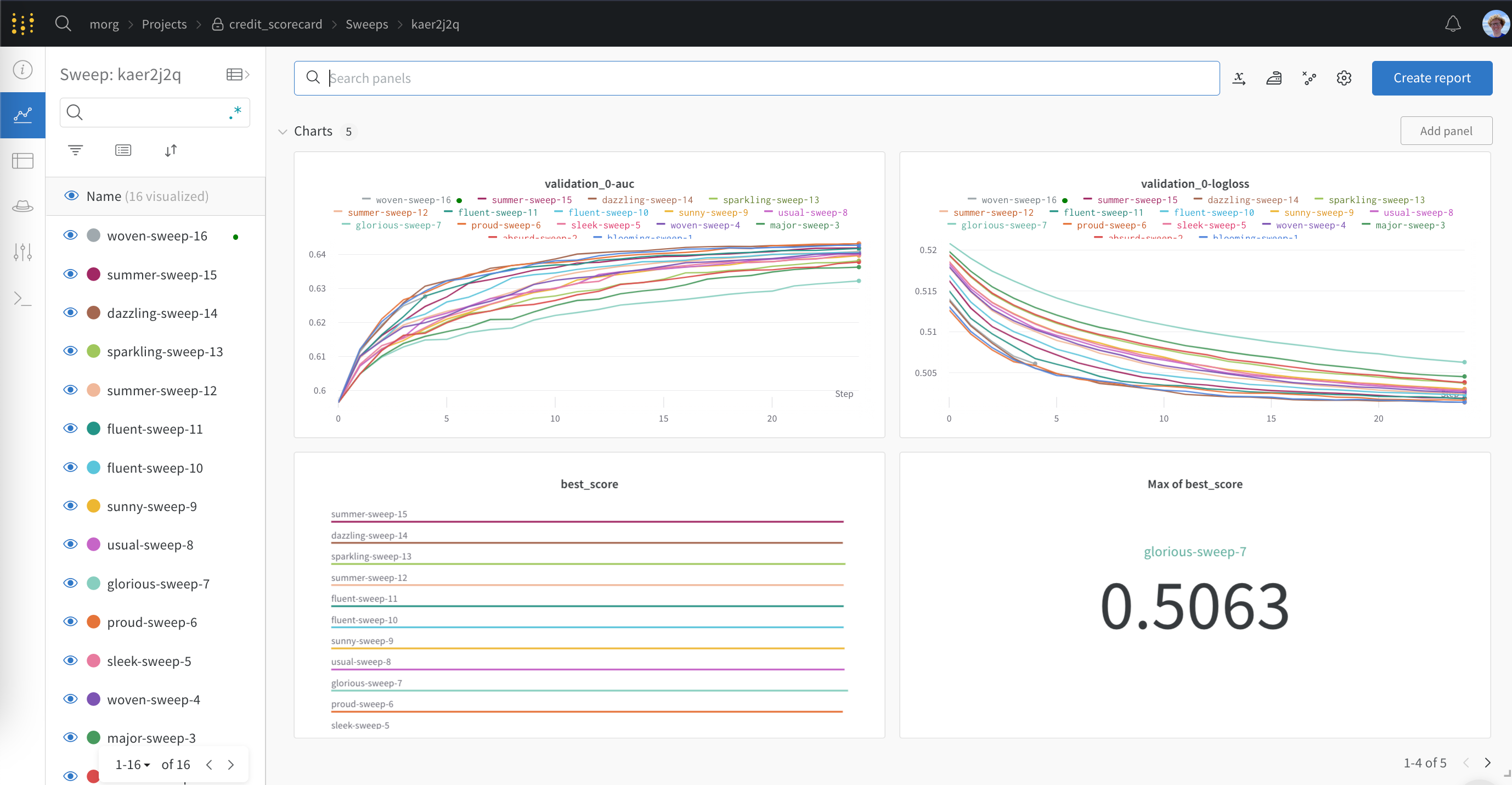

wandb ライブラリには、XGBoost のトレーニングからメトリクス、設定、保存されたブースターをログするための WandbCallback コールバックがあります。ここでは、XGBoost WandbCallback の出力を含む ライブ Weights & Biases ダッシュボード を確認できます。

始めに

XGBoost で収集したメトリクス、設定、ブースターモデルを Weights & Biases にログするのは、XGBoost にWandbCallback を渡すだけで簡単です。

WandbCallback リファレンス

機能

WandbCallback を XGBoost モデルに渡すと、以下のことが行えます:

- ブースターモデルの設定を Weights & Biases にログする

- XGBoost によって収集された評価メトリクス(例: rmse, accuracy)を Weights & Biases にログする

- XGBoost で収集されたトレーニングメトリクスをログする(eval_set にデータを提供する場合)

- 最良のスコアと最良のイテレーションをログする

- トレーニング済みモデルを Weights & Biases Artifacts に保存およびアップロードする(

log_model = Trueの場合) log_feature_importance=True(デフォルト)の場合、特徴重要度のプロットをログするdefine_metric=True(デフォルト)の場合、wandb.summaryに最良の評価メトリックをキャプチャする

引数

-

log_model: (boolean) True の場合、モデルを Weights & Biases Artifacts に保存しアップロードする -

log_feature_importance: (boolean) True の場合、特徴重要度の棒グラフをログする -

importance_type: (str){weight, gain, cover, total_gain, total_cover}のいずれかでツリーモデルに適用。重みは線形モデルに対応。 -

define_metric: (boolean) True(デフォルト)の場合、トレーニングの最良のステップでモデルのパフォーマンスをwandb.summaryにキャプチャする(最後のステップではなく)。

WandbCallback のソースコードを確認できます。

追加の例は、GitHub の例のリポジトリをチェックしてください。

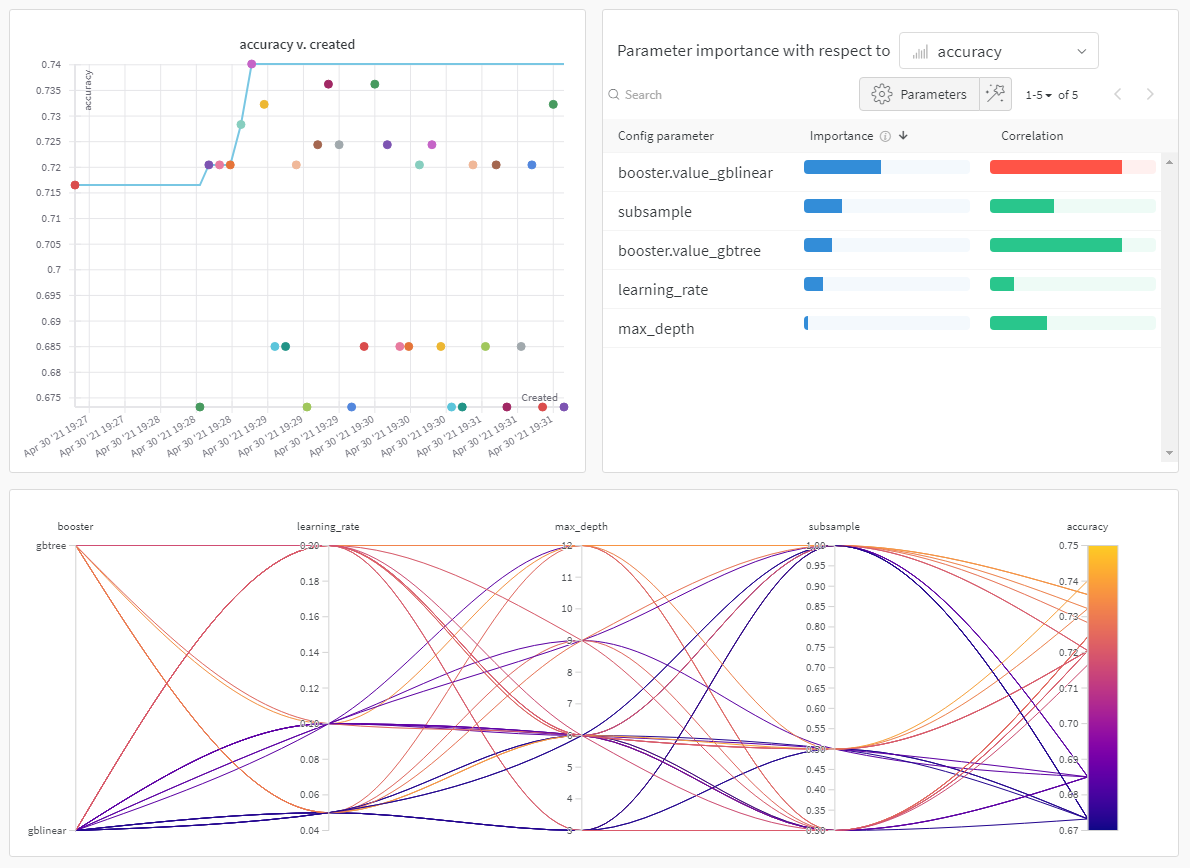

Sweep でハイパーパラメーターをチューニングする

モデルの最大パフォーマンスを引き出すには、ツリーの深さや学習率など、ハイパーパラメーターをチューニングする必要があります。Weights & Biases には、大規模なハイパーパラメーターテスト実験を設定、編成、分析するための強力なツールキットである Sweeps が含まれています。Try in Colab