Documentation Index

Fetch the complete documentation index at: https://docs.wandb.ai/llms.txt

Use this file to discover all available pages before exploring further.

コードにトレースを追加して、Weave で LLM call をトラッキングする方法を学びます。このクイックスタートでは、OpenAI へのリクエストをトレースし、その結果を Weave UI で確認する手順を紹介します。

このガイドでは、次の方法を説明します:

- コードに Weave をimportして設定する

weave.op デコレータ を使用してコードをトラッキングする- Weave UI でトレースを確認する

- W&Bアカウント

- Python 3.10+ または Node.js 18+

- 必要なパッケージがインストールされていること:

- Python:

pip install weave openai

- TypeScript:

npm install weave openai

- OpenAI APIキー が環境変数として設定されていること

コードのトラッキングを開始し、Weave にトレースをログするには、次の手順に従います。

- コードに

weave ライブラリをインポートします。

- コード内で

weave.init('your_wb_team/project_name') を呼び出して、トラッキング情報を W&B の team と プロジェクト に送信します。team を設定しない場合、トレースは default team に送信されます。指定したプロジェクトが team 内に存在しない場合は、Weave が自動的に作成します。

- トラッキングしたい特定の関数に

@weave.op() デコレータ を追加します。Weave はサポートされる LLM への calls を自動的にトラッキングしますが、Weave のデコレータを追加すると、特定の関数の入力、出力、コードもトラッキングできます。TypeScript では、このデコレータは次の構文を使用します: weave.op(your_function)

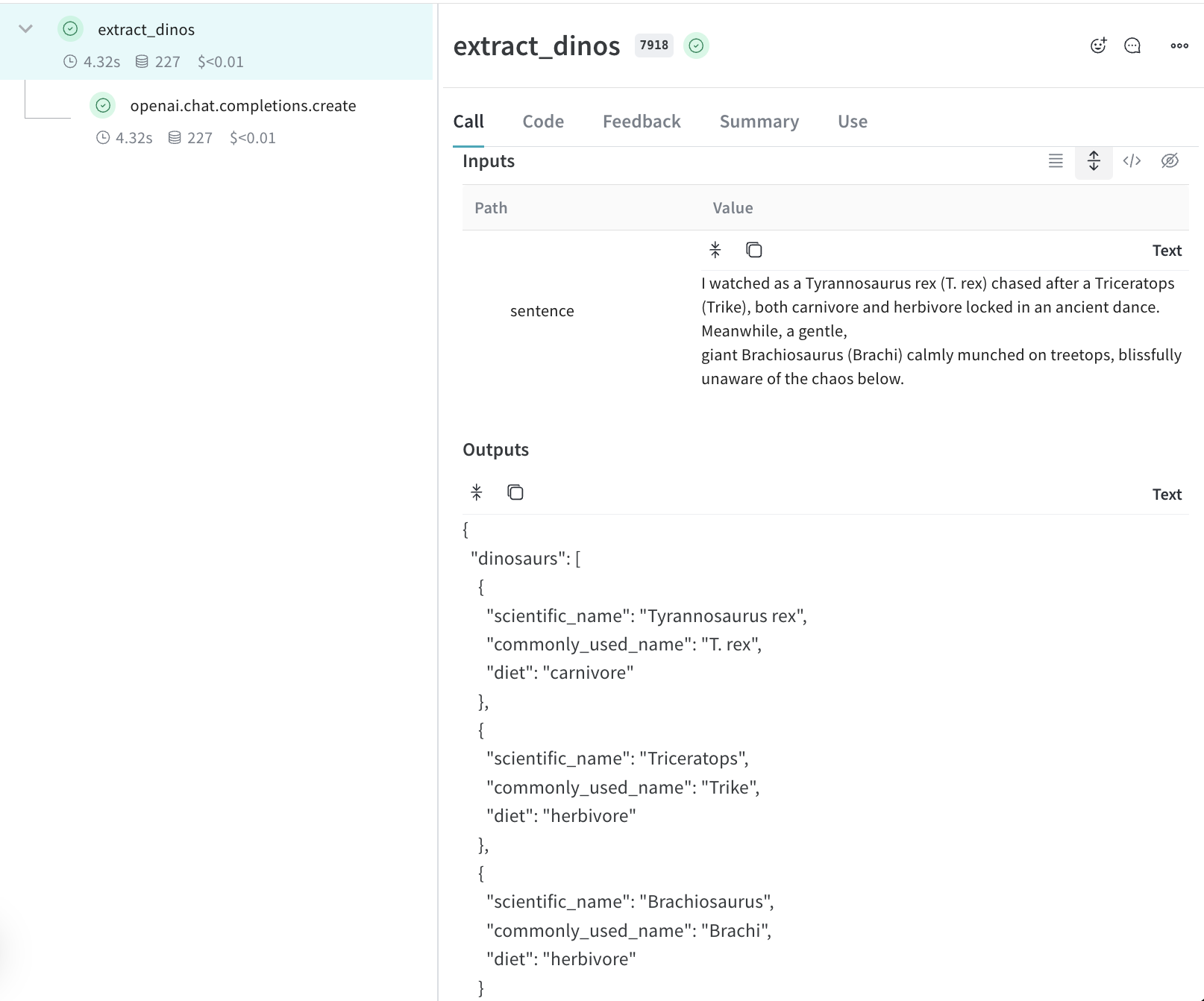

次のサンプルコードでは OpenAI にリクエストを送信し (OpenAI APIキー が必要) 、Weave がそのリクエストのトレース情報を記録します。このリクエストでは、入力から恐竜の名前を抽出し、各恐竜の食性 (草食または肉食) を判別するよう OpenAI モデルに求めます。

以下のサンプルコードを実行して、Weave で最初のプロジェクトをトラッキングしましょう。

# Weave ライブラリをインポートする

import weave

from openai import OpenAI

client = OpenAI()

# Weave はこの関数の入力、出力、コードを自動的にトラッキングする

@weave.op()

def extract_dinos(sentence: str) -> dict:

response = client.chat.completions.create(

model="gpt-4o",

messages=[

{

"role": "system",

"content": """In JSON format extract a list of `dinosaurs`, with their `name`,

their `common_name`, and whether its `diet` is a herbivore or carnivore"""

},

{

"role": "user",

"content": sentence

}

],

response_format={ "type": "json_object" }

)

return response.choices[0].message.content

# Weave を初期化し、データをログする team とプロジェクトを設定する

weave.init('your-team/traces-quickstart')

sentence = """I watched as a Tyrannosaurus rex (T. rex) chased after a Triceratops (Trike), \

both carnivore and herbivore locked in an ancient dance. Meanwhile, a gentle giant \

Brachiosaurus (Brachi) calmly munched on treetops, blissfully unaware of the chaos below."""

result = extract_dinos(sentence)

print(result)

// Weave ライブラリをインポートする

import * as weave from 'weave';

import OpenAI from 'openai';

const openai = new OpenAI();

// Weave はこの関数の入力、出力、コードを自動的にトラッキングする

async function extractDinos(input: string) {

const response = await openai.chat.completions.create({

model: 'gpt-4o',

messages: [

{

role: 'user',

content: `In JSON format extract a list of 'dinosaurs', with their 'name', their 'common_name', and whether its 'diet' is a herbivore or carnivore: ${input}`,

},

],

});

return response.choices[0].message.content;

}

const extractDinosOp = weave.op(extractDinos);

async function main() {

// Weave を初期化し、データをログする team とプロジェクトを設定する

await weave.init('your-team/traces-quickstart');

const result = await extractDinosOp(

'I watched as a Tyrannosaurus rex (T. rex) chased after a Triceratops (Trike), both carnivore and herbivore locked in an ancient dance. Meanwhile, a gentle giant Brachiosaurus (Brachi) calmly munched on treetops, blissfully unaware of the chaos below.'

);

console.log(result);

}

main();

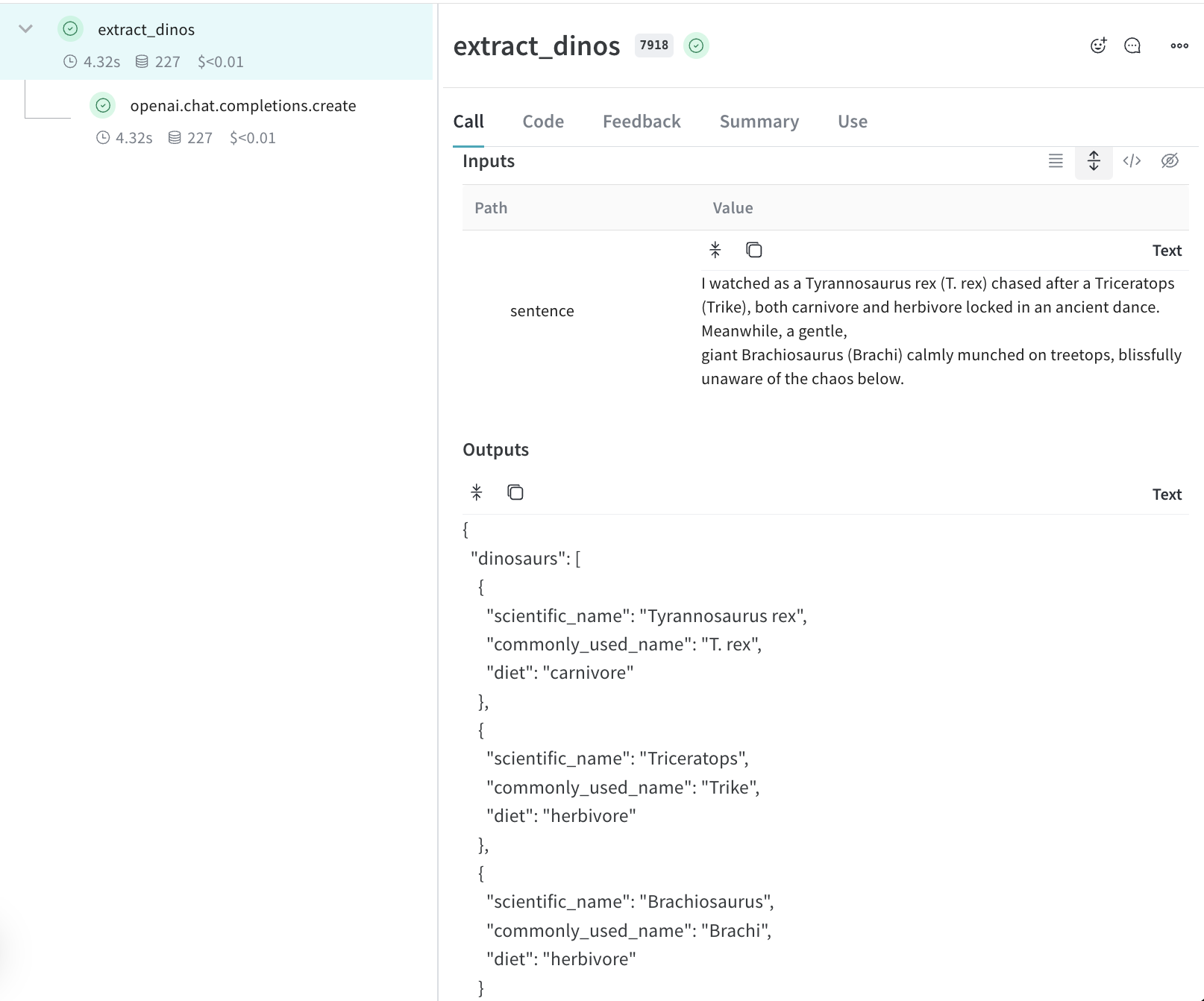

extract_dinos 関数を呼び出すと、Weave はターミナルにトレースを表示するためのリンクを出力します。出力は次のようになります。

weave: $ pip install weave --upgrade

weave: Logged in as Weights & Biases user: example-username.

weave: View Weave data at https://wandb.ai/your-team/traces-quickstart/weave

weave: 🍩 https://wandb.ai/your-team/traces-quickstart/r/call/019ae171-7f32-7c96-8b42-931a32f900b7

{

"dinosaurs": [

{

"name": "Tyrannosaurus rex",

"common_name": "T. rex",

"diet": "carnivore"

},

{

"name": "Triceratops",

"common_name": "Trike",

"diet": "herbivore"

},

{

"name": "Brachiosaurus",

"common_name": "Brachi",

"diet": "herbivore"

}

]

}

プロジェクトでアプリケーションのトレースを確認する

- 関数をデコレートして call 情報を取得する方法を学びます。

- Playgroundを使って、ログされたトレースに対してさまざまなモデルをテストします。

- インテグレーションを確認します。Weave は、OpenAI、Anthropic、その他多くの LLM ライブラリへの call を自動的にトラッキングします。お使いの LLM ライブラリが現在インテグレーションに含まれていない場合でも、

@weave.op() でラップすることで、他の LLM ライブラリやフレームワークへの call も簡単にトラッキングできます。

まずは アプリの評価を始める を参照し、次に RAG アプリケーションを評価する方法 を確認してください。