モニターでは、LLM judges を使用して本番トラフィックを受動的にスコアリングし、LLM アプリケーションにおける傾向や問題を可視化できます。たとえば、アプリケーションの応答をモニタリングして正確性や有用性を確認したり、ユーザー入力をモニタリングして、ユーザーがエージェントに何を尋ねているかの傾向を特定したりできます。モニターはすべてのスコアリング結果を Weave のデータベースに自動的に保存するため、過去の傾向やパターンを分析できます。 アプリケーションの入力と出力に含まれるテキスト、画像、オーディオをモニタリングできます。 モニターの設定にあたって、アプリケーションのコードを変更する必要はありません。W&B Weave UI を使用して設定します。 スコアに基づいてアプリケーションの振る舞いに能動的に介入する必要がある場合は、代わりに guardrails を使用してください。Documentation Index

Fetch the complete documentation index at: https://docs.wandb.ai/llms.txt

Use this file to discover all available pages before exploring further.

Weave で モニター を作成する方法

- W&B UI を開き、Weave プロジェクトを開きます。

- Weave の サイドナビ で Monitors を選択し、+ New Monitor ボタンをクリックします。すると、Create new monitor モーダルダイアログが開きます。

-

Create new monitor メニューで、次のフィールドを設定します。

- Name: 文字または数字で始める必要があります。使用できるのは、文字、数字、ハイフン、アンダースコアです。

- Description (任意) : モニター の内容を説明します。

- Active monitor toggle: モニター のオン/オフを切り替えます。

- Calls to monitor:

- Operations: モニター 対象の

@weave.opを 1 つ以上選択します。利用可能な op の一覧に表示される前に、その op を使用したトレースを少なくとも 1 つログする必要があります。 - Filter (任意) : 対象にする call を絞り込みます (たとえば、

max_tokensやtop_pで絞り込めます) 。 - Sampling rate: score する call の割合です (0% ~ 100%) 。

- Operations: モニター 対象の

- LLM-as-a-judge configuration:

- Scorer name: 文字または数字で始める必要があります。使用できるのは、文字、数字、ハイフン、アンダースコアです。

- Score Audio: 利用可能な LLM モデルをフィルターし、オーディオ対応モデルのみを表示するとともに、Media Scoring JSON Paths フィールドを開きます。

- Score Images: 利用可能な LLM モデルをフィルターし、画像対応モデルのみを表示するとともに、Media Scoring JSON Paths フィールドを開きます。

- Judge model: op を score するモデルを選択します。このメニューには、W&B アカウントで設定した商用 LLM モデルに加えて、Serverless Inference models も含まれます。オーディオ対応モデルには、名前の横に Audio Input ラベルが表示されます。選択したモデルについて、次の Settings を設定します。

- Configuration name: このモデル設定の名です。

- System prompt: 判定モデルの役割とペルソナを定義します。たとえば、“You are an impartial AI judge.” です。

- Response format: 判定モデルが出力する response の形式です。たとえば、

json_objectやプレーンテキストのtextです。 - Scoring prompt: op を score するための評価タスクです。scoring prompt では、op から prompt variables を参照できます。たとえば、“Evaluate whether

{output}is accurate based on{ground_truth}.” のように指定します。

- Media Scoring JSON Paths: Trace Data からメディアを抽出する JSONPath 式 (RFC 9535) を指定します。path を指定しない場合は、ユーザーメッセージ内の score 可能なすべてのメディアが含まれます。このフィールドは、Score Audio または Score Images を有効にすると表示されます。

- モニター の各フィールドを設定したら、Create monitor をクリックします。これで モニター が Weave プロジェクトに追加されます。コードがトレースを生成し始めると、モニター の名を選択し、表示された panel のデータを確認することで、Traces tab で score を確認できます。

feedback フィールドに自動的に保存します。

例: 真実性モニターを作成する

- 文を生成する関数を定義します。真実の文もあれば、そうでない文もあります。

- Python

- TypeScript

- プロジェクトにトレースをログするため、この関数を少なくとも 1 回実行します。これにより、その op を W&B UI でモニタリングできるようになります。

- W&B UI で Weave プロジェクトを開き、サイドナビから Monitors を選択します。次に New Monitor を選択します。

-

Create new monitor メニューで、以下の値を使って各フィールドを設定します。

- Name:

truthfulness-monitor - Description:

Evaluates the truthfulness of generated statements. - Active monitor: on に切り替えます。

- Operations:

generate_statementを選択します。 - Sampling rate: すべての call を score するため、

100%に設定します。 - Scorer name:

truthfulness-scorer - Judge model:

o3-mini-2025-01-31 - System prompt:

You are an impartial AI judge. Your task is to evaluate the truthfulness of statements. - Response format:

json_object - Scoring prompt:

- Name:

- Create Monitor をクリックします。これにより、モニターが Weave プロジェクトに追加されます。

- スコアリング関数をテストするため、スクリプト内で真実性の度合いが異なる文を使って関数を呼び出します。

- Python

- TypeScript

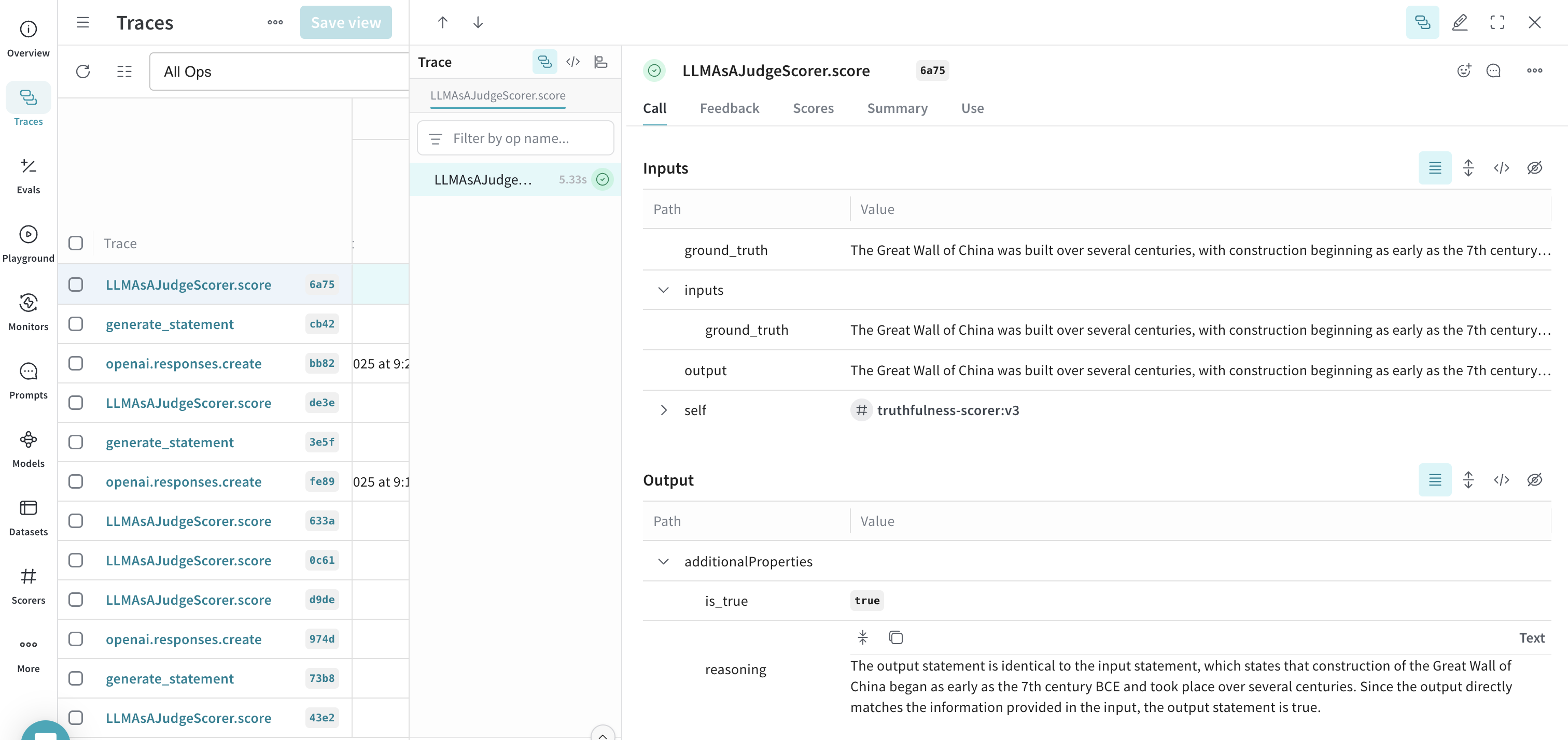

- いくつか異なる文でスクリプトを実行した後、W&B UI を開いて Traces タブにアクセスします。任意の LLMAsAJudgeScorer.score トレースを選択して、結果を確認します。