Documentation Index

Fetch the complete documentation index at: https://docs.wandb.ai/llms.txt

Use this file to discover all available pages before exploring further.

これはインタラクティブなノートブックです。ローカルで実行することも、以下のリンクを使用することもできます。 import し、W&B APIキーを取得し、Weaveプロジェクトを初期化してください。

# 必要な依存関係をインストールする

!pip install openai weave -q

python

import json

import os

from google.colab import userdata

from openai import OpenAI

import weave

python

# APIキーを取得する

os.environ["OPENAI_API_KEY"] = userdata.get(

"OPENAI_API_KEY"

) # 左側のメニューからColabの環境シークレットとしてキーを設定してください

os.environ["WANDB_API_KEY"] = userdata.get("WANDB_API_KEY")

# プロジェクト名を設定する

# PROJECT の値を自分のプロジェクト名に置き換えてください

PROJECT = "vlm-handwritten-ner"

# Weave プロジェクトを初期化する

weave.init(PROJECT)

1. Weave でプロンプトを作成し、改善を重ねる

# Weave でプロンプトオブジェクトを作成する

prompt = """

Extract all readable text from this image. Format the extracted entities as a valid JSON.

Do not return any extra text, just the JSON. Do not include ```json```

Use the following format:

{"Patient Name": "James James","Date": "4/22/2025","Patient ID": "ZZZZZZZ123","Group Number": "3452542525"}

"""

system_prompt = weave.StringPrompt(prompt)

# プロンプトを Weave に公開する

weave.publish(system_prompt, name="NER-prompt")

better_prompt = """

You are a precision OCR assistant. Given an image of patient information, extract exactly these fields into a single JSON object—and nothing else:

- Patient Name

- Date (MM/DD/YYYY)

- Patient ID

- Group Number

Validation rules:

1. Date must match MM/DD/YY; if not, set Date to "".

2. Patient ID must be alphanumeric; if unreadable, set to "".

3. Always zero-pad months and days (e.g. "04/07/25").

4. Omit any markup, commentary, or code fences.

5. Return strictly valid JSON with only those four keys.

Do not return any extra text, just the JSON. Do not include ```json```

Example output:

{"Patient Name":"James James","Date":"04/22/25","Patient ID":"ZZZZZZZ123","Group Number":"3452542525"}

"""

# プロンプトを編集する

system_prompt = weave.StringPrompt(better_prompt)

# 編集したプロンプトをWeaveに公開する

weave.publish(system_prompt, name="NER-prompt")

base64 でエンコードされているため、前処理なしでそのまま LLM で使用できます。

# 以下のWeaveプロジェクトからデータセットを取得する

dataset = weave.ref(

"weave://wandb-smle/vlm-handwritten-ner/object/NER-eval-dataset:G8MEkqWBtvIxPYAY23sXLvqp8JKZ37Cj0PgcG19dGjw"

).get()

# データセット内の特定のサンプルにアクセスする

example_image = dataset.rows[3]["image_base64"]

# example_imageを表示する

from IPython.display import HTML, display

html = f'<img src="{example_image}" style="max-width: 100%; height: auto;">'

display(HTML(html))

- データセット内の PIL 画像を受け取り、VLM に渡せる画像の

base64 エンコード済み文字列を返す encode_image 関数

- 画像と system prompt を受け取り、system prompt に記述されたとおりにその画像から抽出した Entities を返す

extract_named_entities_from_image 関数

# GPT-4-Visionを使用したトレース可能な関数

def extract_named_entities_from_image(image_base64) -> dict:

# LLMクライアントの初期化

client = OpenAI()

# 指示プロンプトの設定

# Weaveに保存されたプロンプトをweave.ref("weave://wandb-smle/vlm-handwritten-ner/object/NER-prompt:FmCv4xS3RFU21wmNHsIYUFal3cxjtAkegz2ylM25iB8").get().content.strip()で使用することも可能です

prompt = better_prompt

response = client.responses.create(

model="gpt-4.1",

input=[

{

"role": "user",

"content": [

{"type": "input_text", "text": prompt},

{

"type": "input_image",

"image_url": image_base64,

},

],

}

],

)

return response.output_text

named_entity_recognation という関数を作成します。これには次の処理を実装します。

- 画像データを NER パイプラインに渡す

- 結果を正しい形式の JSON で返す

W&B UI で関数の実行を自動的にトラッキングおよびトレースするには、@weave.op() decorator デコレータを使用します。

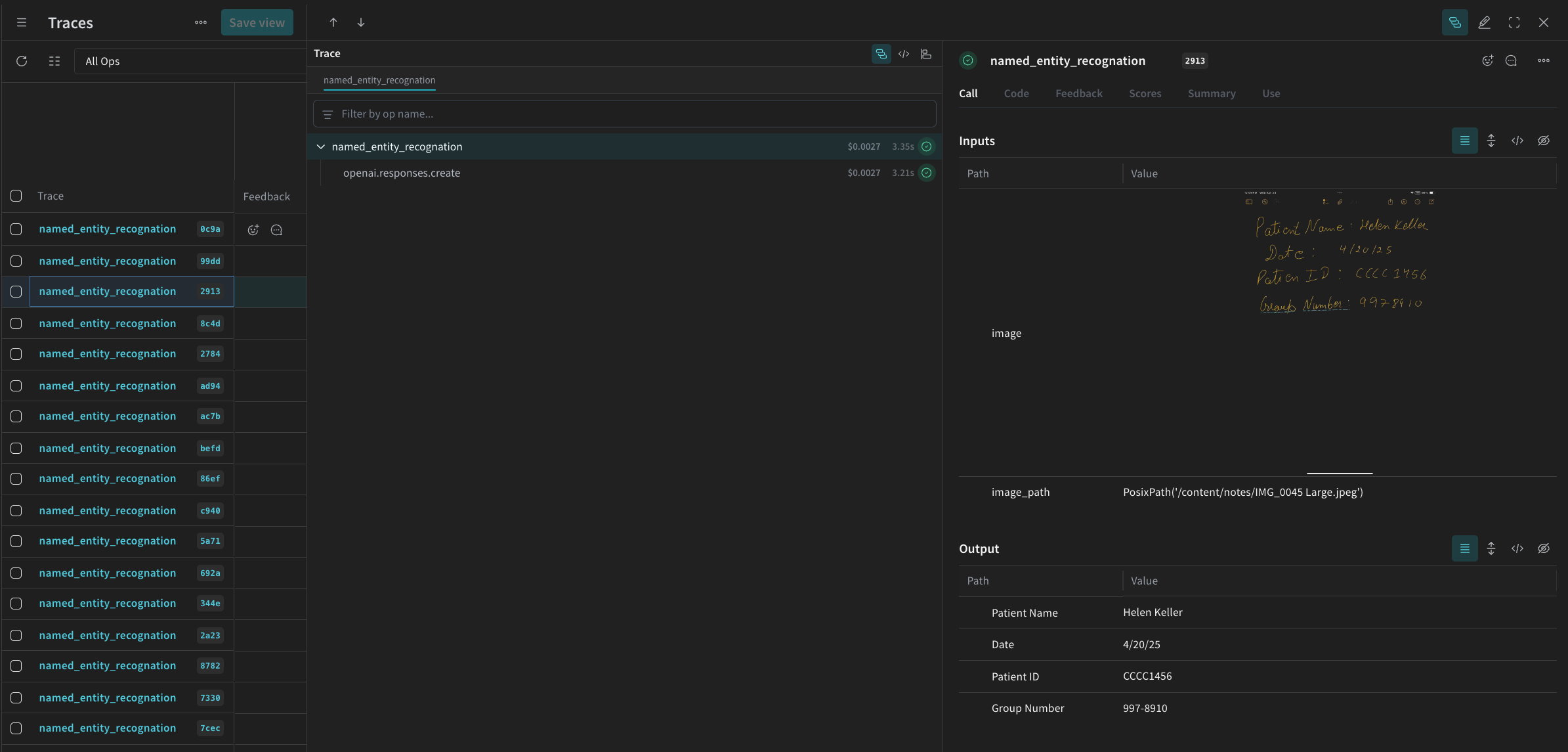

named_entity_recognation を実行するたびに、完全なトレース結果が Weave UI に表示されます。トレースを表示するには、Weave プロジェクトの トレース タブにアクセスします。

# 評価用NER関数

@weave.op()

def named_entity_recognation(image_base64, id):

result = {}

try:

# 1) vision opを呼び出し、JSON文字列を取得する

output_text = extract_named_entities_from_image(image_base64)

# 2) JSONを一度だけパースする

result = json.loads(output_text)

print(f"Processed: {str(id)}")

except Exception as e:

print(f"Failed to process {str(id)}: {e}")

return result

processing_results.json に保存します。結果は Weave UI でも確認できます。

# 結果を出力

results = []

# データセット内のすべての画像をループ処理

for row in dataset.rows:

result = named_entity_recognation(row["image_base64"], str(row["id"]))

result["image_id"] = str(row["id"])

results.append(result)

# すべての結果をJSONファイルに保存

output_file = "processing_results.json"

with open(output_file, "w") as f:

json.dump(results, f, indent=2)

print(f"Results saved to: {output_file}")

- プログラムによる Scorer

- LLM-as-a-judge Scorer

プログラムベースのスコアラー check_for_missing_fields_programatically は、モデルの出力 (named_entity_recognition 関数の出力) を受け取り、結果内で欠けている、または空の keys を特定します。

このチェックは、モデルがいずれかのフィールドを取りこぼしたサンプルを特定するのに非常に役立ちます。

# スコアラーの実行をトラッキングするために weave.op() を追加する

@weave.op()

def check_for_missing_fields_programatically(model_output):

# すべてのエントリに必須のキー

required_fields = {"Patient Name", "Date", "Patient ID", "Group Number"}

for key in required_fields:

if (

key not in model_output

or model_output[key] is None

or str(model_output[key]).strip() == ""

):

return False # このエントリにはフィールドの欠損または空白がある

return True # すべての必須フィールドが存在し、かつ空でない

check_for_missing_fields_with_llm は、LLM (具体的にはOpenAIのgpt-4o) を使用してスコアリングを行います。eval_promptの内容で指定されているとおり、check_for_missing_fields_with_llmはBoolean値を出力します。すべてのフィールドが画像内の情報と一致し、フォーマットが正しければ、Scorerはtrueを返します。いずれかのフィールドが欠落している、空である、誤っている、または一致していない場合、結果はfalseとなり、scorerは問題を説明するメッセージも返します。

# LLM-as-a-judge の system prompt

eval_prompt = """

You are an OCR validation system. Your role is to assess whether the structured text extracted from an image accurately reflects the information in that image.

Only validate the structured text and use the image as your source of truth.

Expected input text format:

{"Patient Name": "First Last", "Date": "04/23/25", "Patient ID": "131313JJH", "Group Number": "35453453"}

Evaluation criteria:

- All four fields must be present.

- No field should be empty or contain placeholder/malformed values.

- The "Date" should be in MM/DD/YY format (e.g., "04/07/25") (zero padding the date is allowed)

Scoring:

- Return: {"Correct": true, "Reason": ""} if **all fields** match the information in the image and formatting is correct.

- Return: {"Correct": false, "Reason": "EXPLANATION"} if **any** field is missing, empty, incorrect, or mismatched.

Output requirements:

- Respond with a valid JSON object only.

- "Correct" must be a JSON boolean: true or false (not a string or number).

- "Reason" must be a short, specific string indicating all the problem — e.g., "Patient Name mismatch", "Date not zero-padded", or "Missing Group Number".

- Do not return any additional explanation or formatting.

Your response must be exactly one of the following:

{"Correct": true, "Reason": null}

OR

{"Correct": false, "Reason": "EXPLANATION_HERE"}

"""

# weave.op() を追加して Scorer の実行をトラッキングする

@weave.op()

def check_for_missing_fields_with_llm(model_output, image_base64):

client = OpenAI()

response = client.chat.completions.create(

model="gpt-4o",

messages=[

{"role": "developer", "content": [{"text": eval_prompt, "type": "text"}]},

{

"role": "user",

"content": [

{

"type": "image_url",

"image_url": {

"url": image_base64,

},

},

{"type": "text", "text": str(model_output)},

],

},

],

response_format={"type": "json_object"},

)

response = json.loads(response.choices[0].message.content)

return response

dataset を自動的に反復処理し、結果をまとめて Weave UI にログする評価 call を定義します。

次のコードは評価を開始し、NER パイプラインの各出力に 2 つの Scorers を適用します。結果は Weave UI の Evals タブで確認できます。

evaluation = weave.Evaluation(

dataset=dataset,

scorers=[

check_for_missing_fields_with_llm,

check_for_missing_fields_programatically,

],

name="Evaluate_4.1_NER",

)

print(await evaluation.evaluate(named_entity_recognation))