Documentation Index

Fetch the complete documentation index at: https://docs.wandb.ai/llms.txt

Use this file to discover all available pages before exploring further.

このページに掲載されているコードサンプルは、すべて Python で記述されています。

Google Colab で Hugging Face Hub と Weave を試す

面倒な設定なしで Hugging Face Hub と Weave を試してみたいですか? ここで紹介しているコードサンプルは、Google Colab 上の Jupyter Notebook として試せます。

huggingface_hub Python ライブラリは、Hub でホストされているモデルに対して、複数のサービスをまたいで推論を実行できる統一インターフェースを提供します。これらのモデルは InferenceClient を使用して呼び出せます。

Weave は InferenceClient のトレースを自動的に取得します。トラッキングを開始するには、weave.init() を呼び出してから、通常どおりライブラリを使用します。

-

Weave で

huggingface_hub を使用する前に、必要なライブラリをインストールするか、最新バージョンにアップグレードする必要があります。次のコマンドは、huggingface_hub と weave をインストールし、すでにインストール済みの場合は最新バージョンにアップグレードします。また、インストール時の出力も抑制します。

pip install -U huggingface_hub weave -qqq

-

Hugging Face Hub 上のモデルで 推論 を使用するには、User Access Token を設定します。トークンは Hugging Face Hub の Settings ページ で設定することも、プログラムから設定することもできます。次のコード例では、ユーザーに

HUGGINGFACE_TOKEN の入力を求め、そのトークンを環境変数に設定します。

import os

import getpass

os.environ["HUGGINGFACE_TOKEN"] = getpass.getpass("Enter your Hugging Face Hub Token: ")

開発時と本番環境では、言語モデルアプリケーションのトレースを一元的に保存することが重要です。これらのトレースはデバッグに役立つだけでなく、アプリケーションを改善するための有用なデータセットにもなります。

Weave は InferenceClient のトレースを自動的に取得します。トラッキングを開始するには、weave.init() を呼び出して Weave を初期化し、その後は通常どおりライブラリを使用します。

次の例では、Weave を使用して Hugging Face Hub への推論 call をログする方法を示します。

import weave

from huggingface_hub import InferenceClient

# Weave を初期化する

weave.init(project_name="quickstart-huggingface")

# Hugging Face Inference Client を初期化する

huggingface_client = InferenceClient(

api_key=os.environ.get("HUGGINGFACE_TOKEN")

)

# Llama-3.2-11B-Vision-Instruct モデルを使用して Hugging Face Hub にチャット補完の推論呼び出しを行う

image_url = "https://cdn.britannica.com/61/93061-050-99147DCE/Statue-of-Liberty-Island-New-York-Bay.jpg"

response = huggingface_client.chat_completion(

model="meta-llama/Llama-3.2-11B-Vision-Instruct",

messages=[

{

"role": "user",

"content": [

{"type": "image_url", "image_url": {"url": image_url}},

{"type": "text", "text": "Describe this image in one sentence."},

],

}

],

max_tokens=500,

seed=42,

)

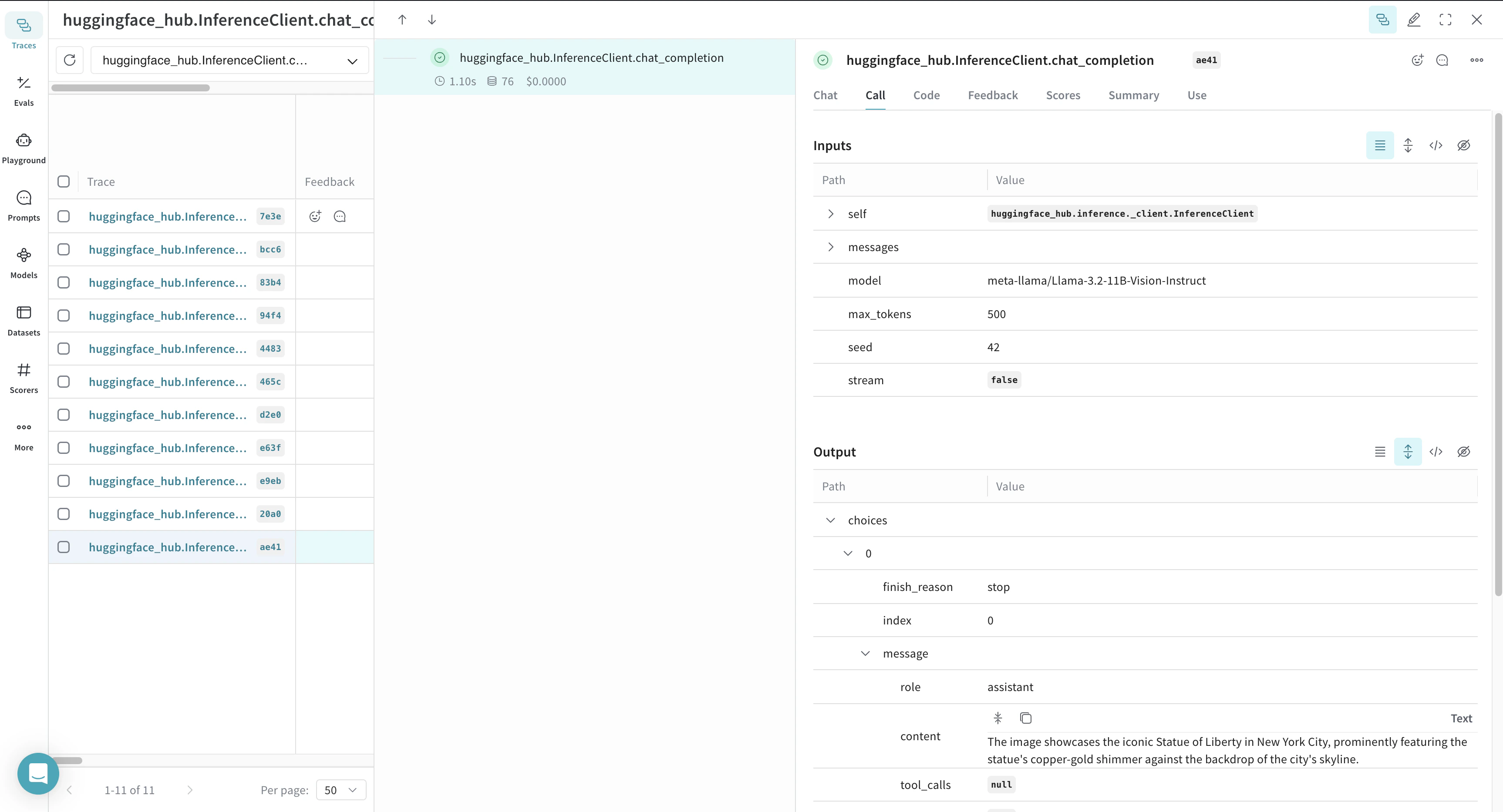

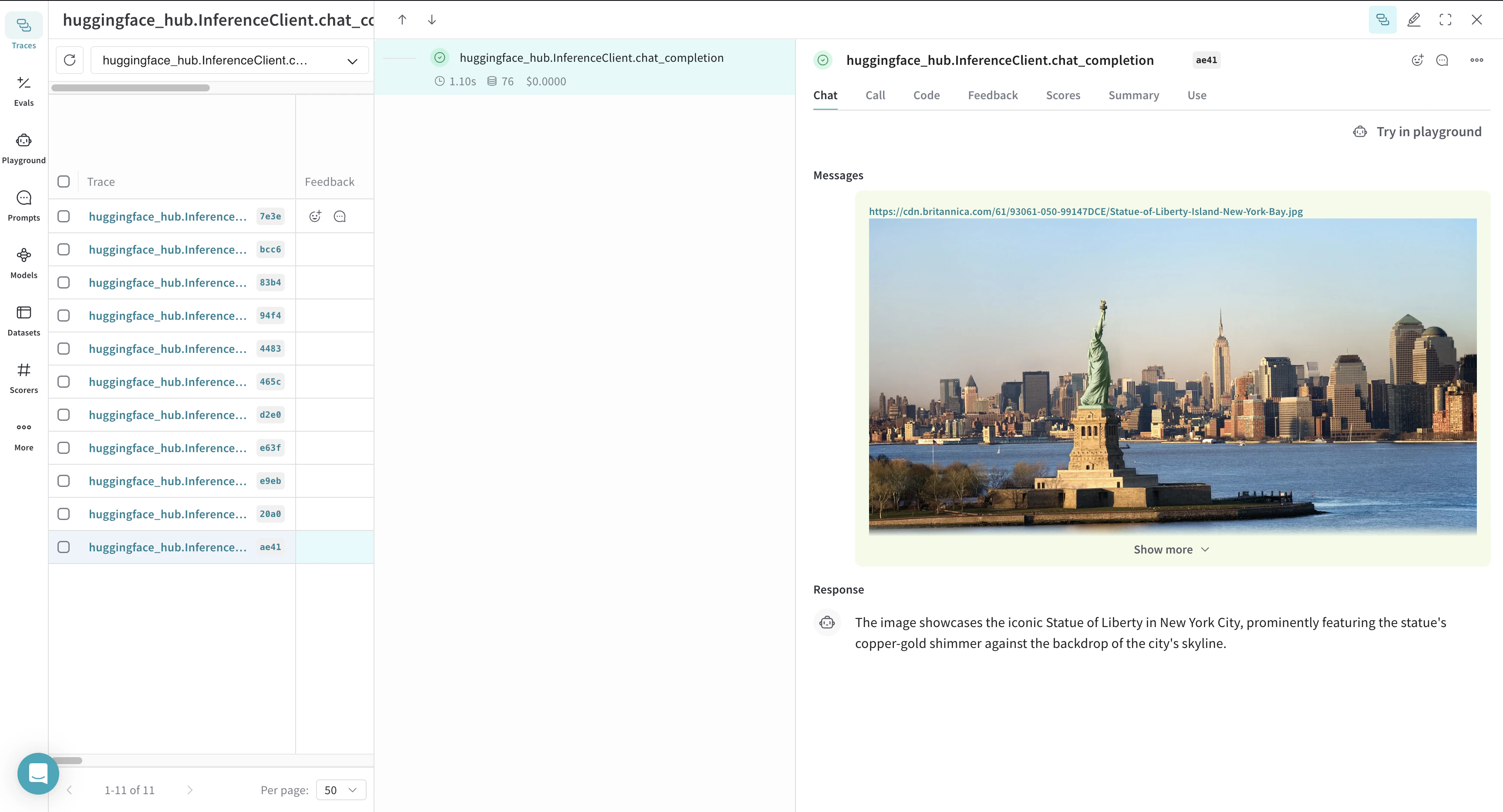

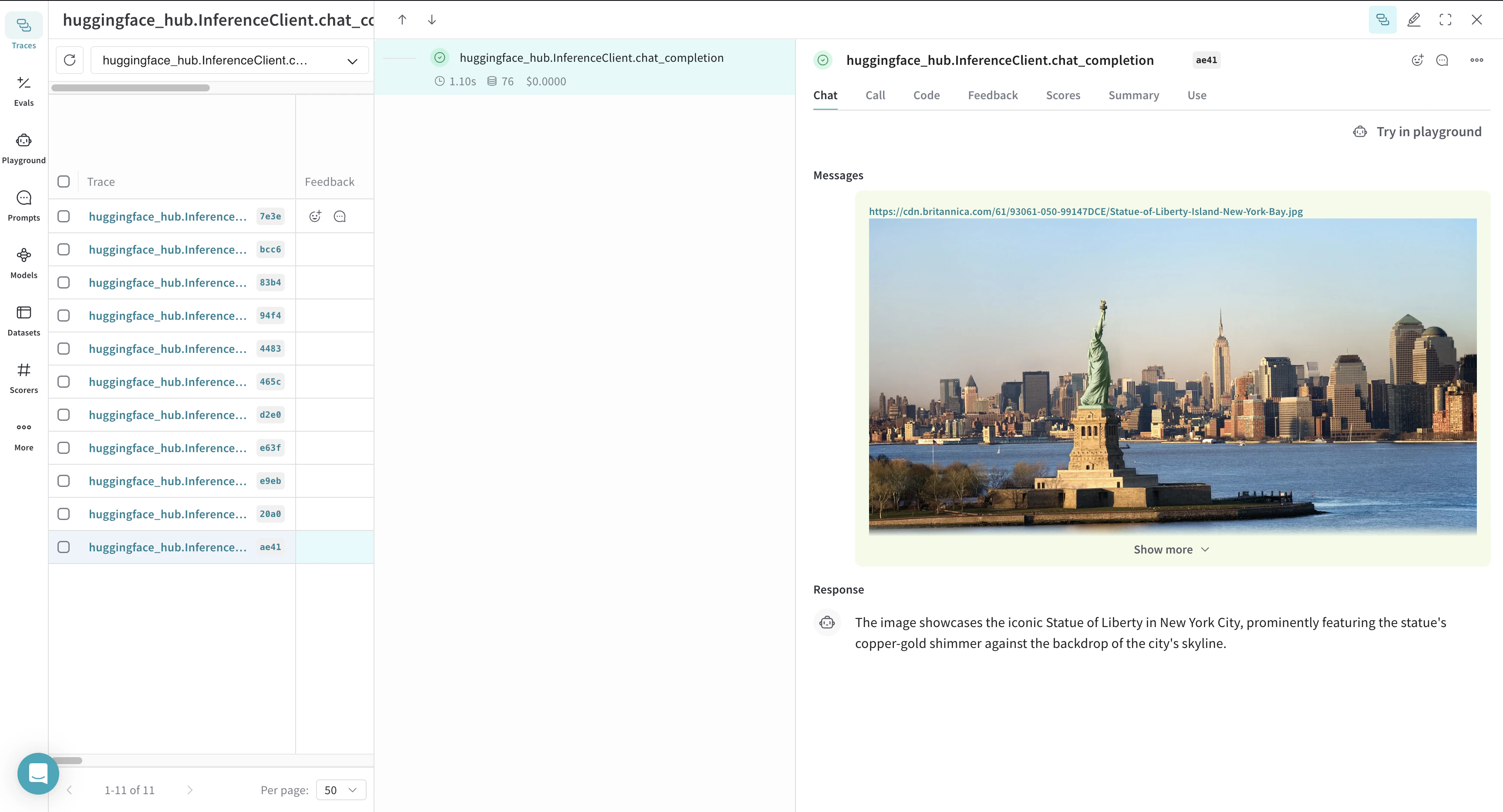

Weave はその call を UI上でチャットビューとして表示し、モデルとのチャット履歴全体を確認できます。

アプリケーション内でデータがどのように流れるかをより深く把握するには、

Weave はその call を UI上でチャットビューとして表示し、モデルとのチャット履歴全体を確認できます。

アプリケーション内でデータがどのように流れるかをより深く把握するには、@weave.op を使用して関数のcallをトラッキングできます。これにより、入力、出力、実行ロジックが記録され、デバッグやパフォーマンス分析に役立ちます。

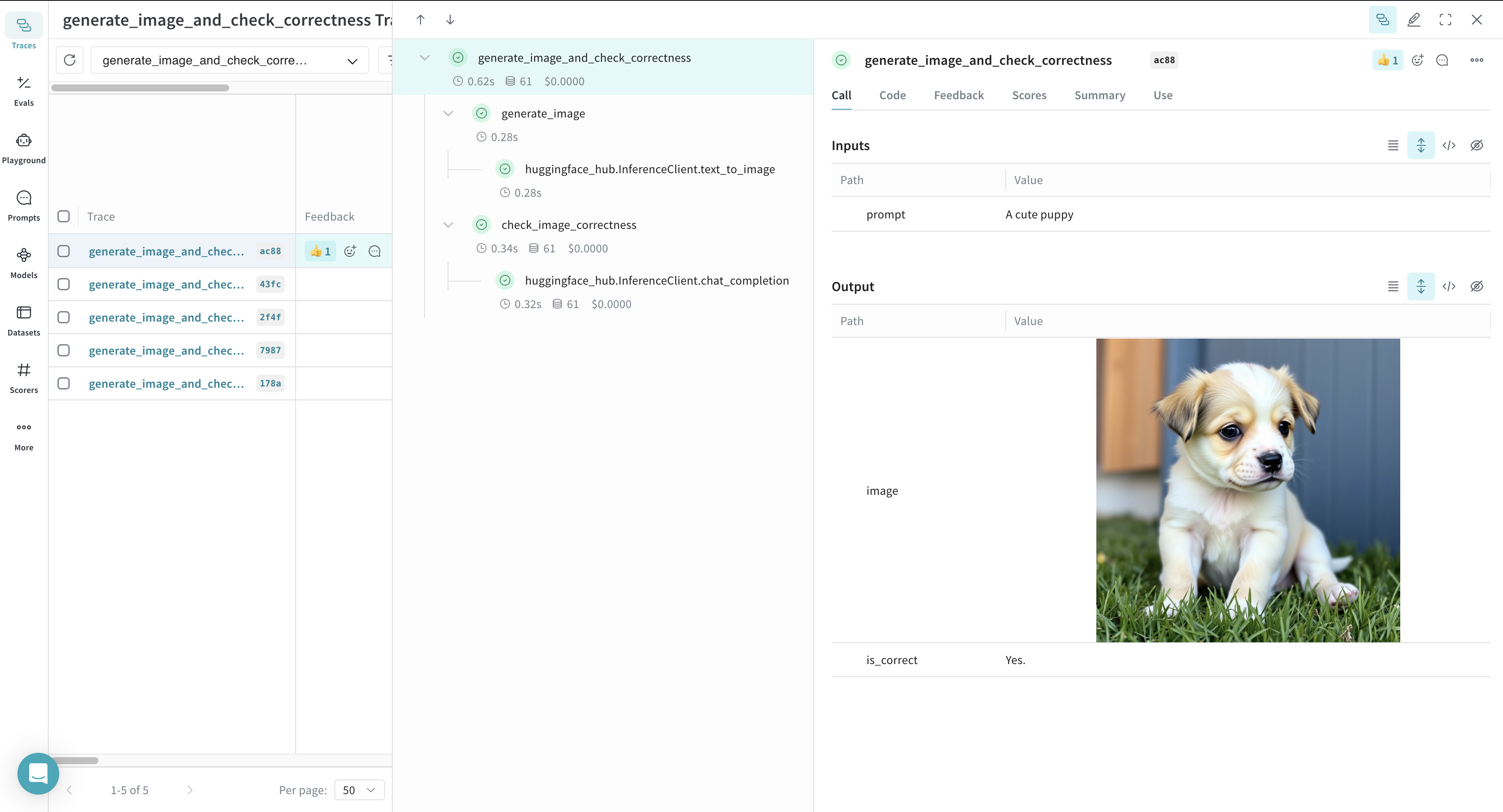

複数の op をネストすると、トラッキングされた関数の構造化されたツリーを構築できます。Weave はコードも自動的にバージョン管理するため、Git に変更をコミットする前であっても、実験中の中間状態が保持されます。

トラッキングを開始するには、トラッキングしたい関数に @weave.op デコレータを付けます。

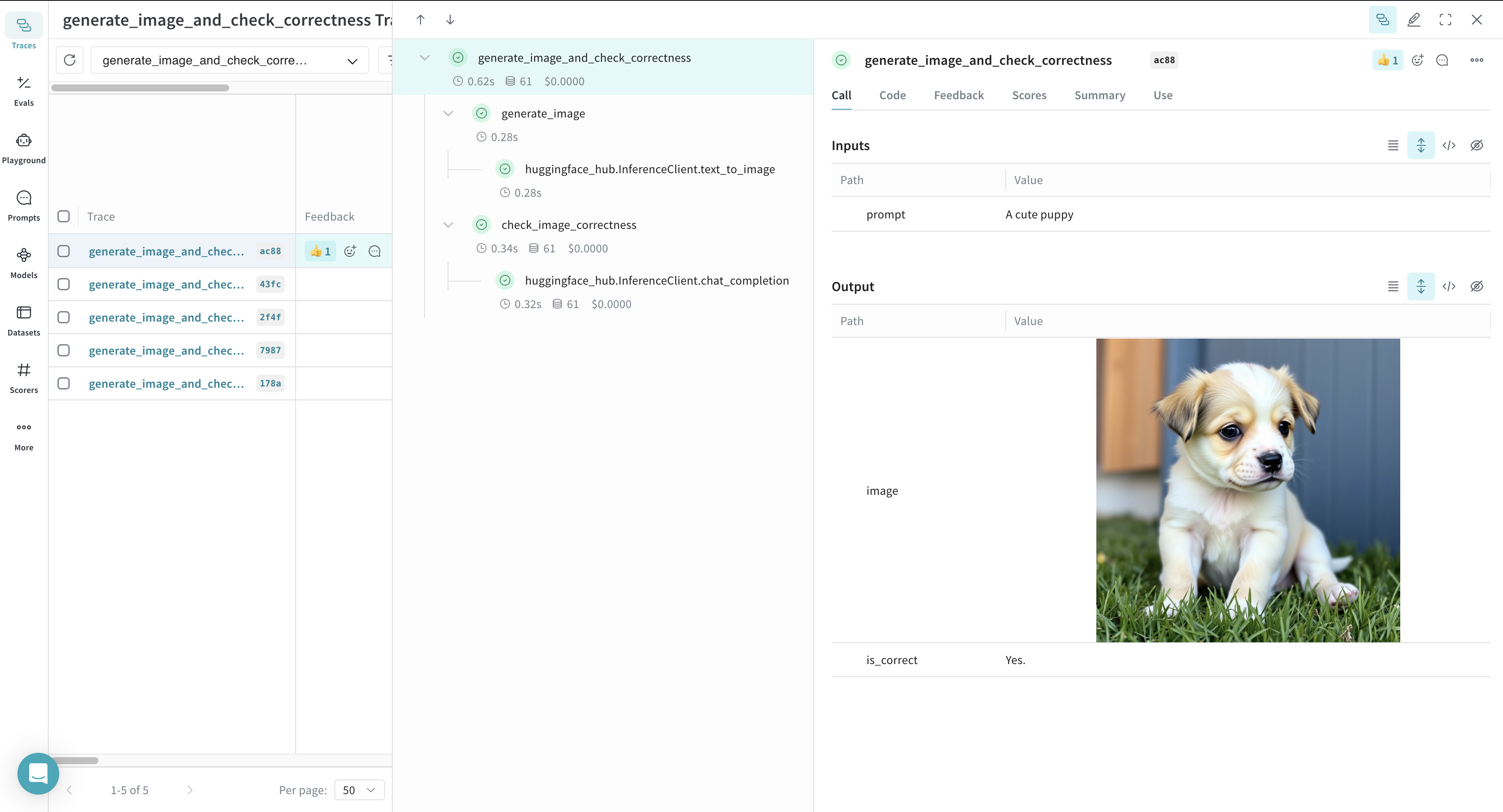

次の例では、Weave は generate_image、check_image_correctness、generate_image_and_check_correctness の 3 つの関数をトラッキングします。これらの関数は画像を生成し、それが指定されたプロンプトに一致するかどうかを検証します。

import base64

from PIL import Image

def encode_image(pil_image):

import io

buffer = io.BytesIO()

pil_image.save(buffer, format="JPEG")

buffer.seek(0)

encoded_image = base64.b64encode(buffer.read()).decode("utf-8")

return f"data:image/jpeg;base64,{encoded_image}"

@weave.op

def generate_image(prompt: str):

return huggingface_client.text_to_image(

prompt=prompt,

model="black-forest-labs/FLUX.1-schnell",

num_inference_steps=4,

)

@weave.op

def check_image_correctness(image: Image.Image, image_generation_prompt: str):

return huggingface_client.chat_completion(

model="meta-llama/Llama-3.2-11B-Vision-Instruct",

messages=[

{

"role": "user",

"content": [

{"type": "image_url", "image_url": {"url": encode_image(image)}},

{

"type": "text",

"text": f"Is this image correct for the prompt: {image_generation_prompt}? Answer with only one word: yes or no",

},

],

}

],

max_tokens=500,

seed=42,

).choices[0].message.content

@weave.op

def generate_image_and_check_correctness(prompt: str):

image = generate_image(prompt)

return {

"image": image,

"is_correct": check_image_correctness(image, prompt),

}

response = generate_image_and_check_correctness("A cute puppy")

@weave.op でラップされたすべての関数callがログされるため、Weave UI で実行の詳細を分析できます。

Weave は関数の実行も記録して可視化するため、アプリケーション内のデータフローやロジックを把握しやすくなります。

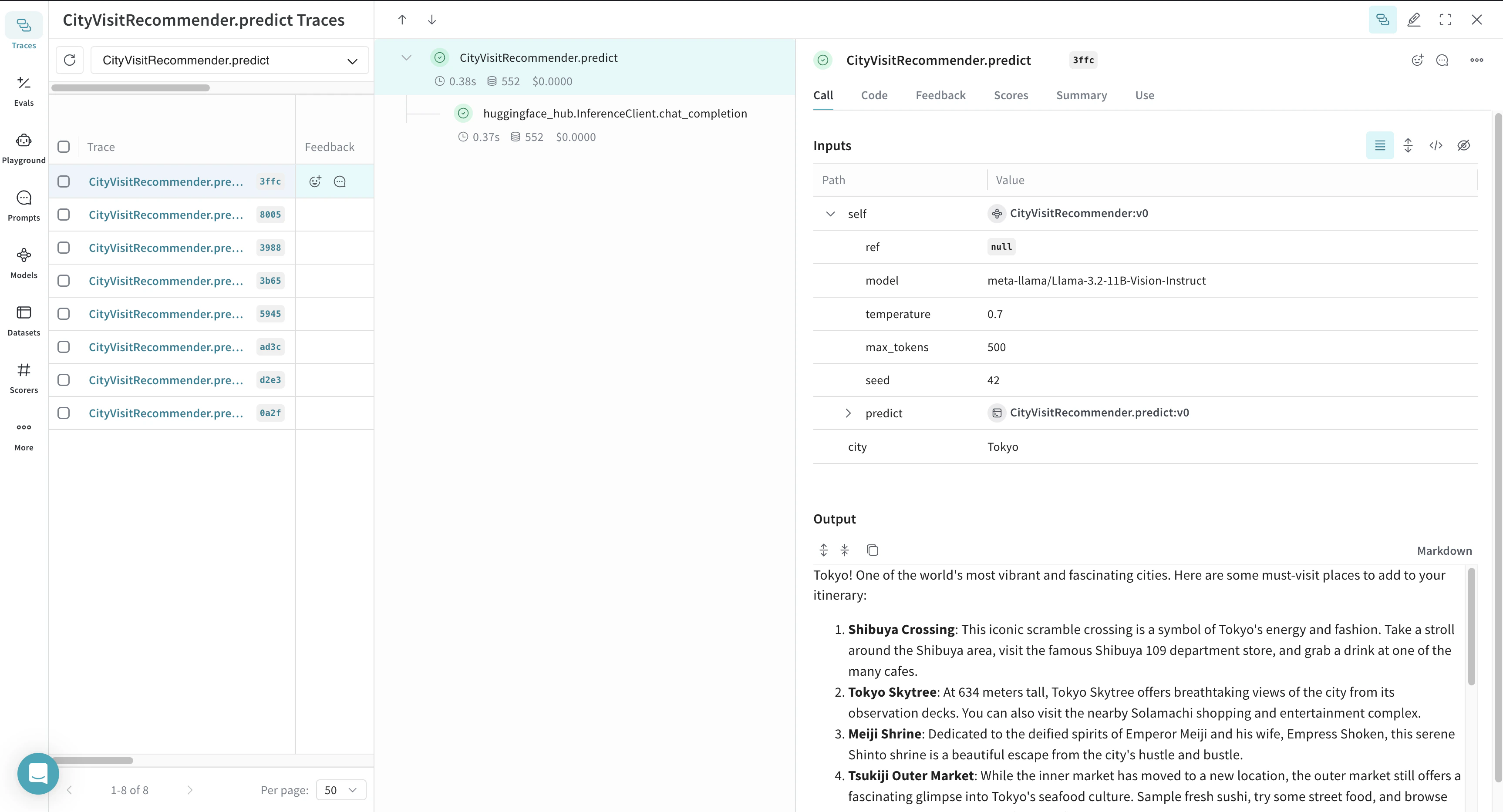

Weave は関数の実行も記録して可視化するため、アプリケーション内のデータフローやロジックを把握しやすくなります。Model クラスを使うと、system prompt やモデル設定などの実験の詳細を記録して整理でき、異なるイテレーションを簡単に比較できます。

コードのバージョン管理や入出力の記録に加えて、Model にはアプリケーションの動作を制御する構造化されたパラメーターも保存されます。これにより、どの設定が最良の結果をもたらしたかをトラッキングしやすくなります。さらに詳しく分析するために、Weave Model を Weave Serve や Evaluations と統合することもできます。

次の例では、旅行のおすすめ用の CityVisitRecommender モデルを定義します。パラメーターを変更するたびに新しいバージョンが生成されるため、実験を簡単に進められます。

import rich

class CityVisitRecommender(weave.Model):

model: str

temperature: float = 0.7

max_tokens: int = 500

seed: int = 42

@weave.op()

def predict(self, city: str) -> str:

return huggingface_client.chat_completion(

model=self.model,

messages=[

{

"role": "system",

"content": "You are a helpful assistant meant to suggest places to visit in a city",

},

{"role": "user", "content": city},

],

max_tokens=self.max_tokens,

temperature=self.temperature,

seed=self.seed,

).choices[0].message.content

city_visit_recommender = CityVisitRecommender(

model="meta-llama/Llama-3.2-11B-Vision-Instruct",

temperature=0.7,

max_tokens=500,

seed=42,

)

rich.print(city_visit_recommender.predict("New York City"))

rich.print(city_visit_recommender.predict("Paris"))